本来なら例の書籍を読み進めて少しずつ理解していくつもりだったけど、しんどい。。。

書籍はなかなか読み進められなかったので、飛ばし読みしてプログラムを動かしながら徐々にディティールを理解していく方針へ切り替えた(笑)

何度か格闘するも上手くいかないOpenCVのsfmモジュールのビルドもいったん諦めて、もっとプリミティブな関数をいじってお勉強しようと思う。

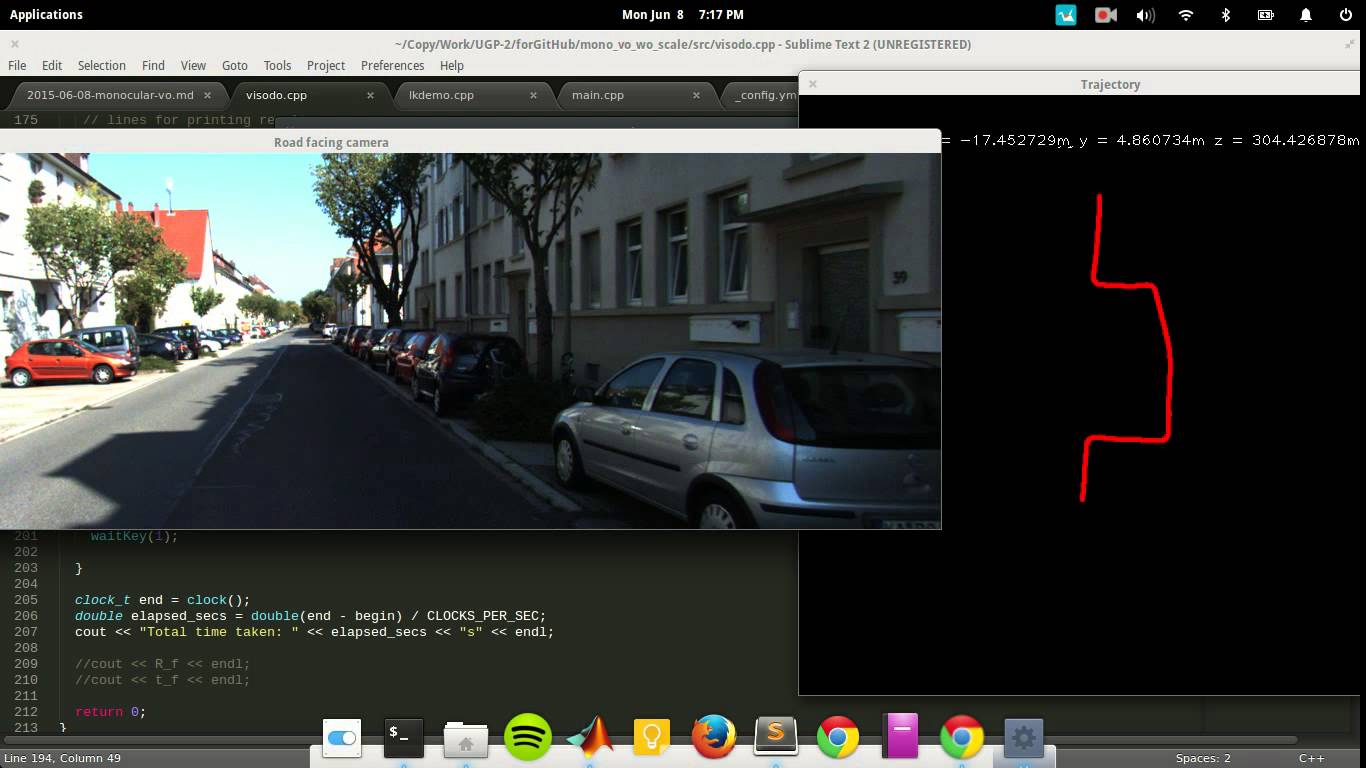

以前見つけたこちらのチュートリアルのサンプルコードでfindEssentialMat関数、つまりNist´erの5点アルゴリズムをいじってみる。

このサンプルコードはヘッダーファイルを含めても300行未満なので読みやすいはず。

https://github.com/avisingh599/mono-vo

このリポジトリのmono-vo/src/visodo.cppを読んでみる。

というか、まずはこのブログ記事を読むところからかな。

http://avisingh599.github.io/vision/monocular-vo/

ブログ記事の一部を雑に日本語訳。

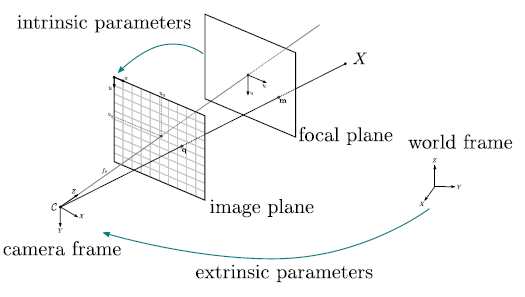

課題設定 (Formulation of the problem)

Input

カメラから取得したグレイスケールのストリーム画像を入力とし、時刻

, 時刻

の時点で取得した画像をそれぞれ

,

と呼びます。カメラの固有パラメータは事前にキャリブレーションによって取得済みです。キャリブレーションはOpenCVでも行うことができます。

Output

全ての画像ペアで、2枚の画像間の車両の移動を表す回転行列

と並進ベクトル

を求める必要があります。我々の単眼手法では並進ベクトル

のスケール要素までは計算できません。

アルゴリズムの概要 (Algorithm Outline)

- 画像ペア:

,

の取得

- 上記画像の歪みを補正する。

からFASTアルゴリズムで特徴点を抽出し、それらの特徴点の

までの移動を追跡する。 特徴点の数が特定の閾値を下回った場合、新しい特徴点を検出する。

- Nisterの5点アルゴリズム(with RANSAC)によってEssential Matrix(基本行列)を算出する。

- 上記ステップで求めたEssential Matrix(基本行列)から

と

を推定する。

- スピードメーター等の外部ソースからスケール情報を取得し、並進ベクトル

と回転行列

とを連結する。

ということで、詳しく知りたいのは特に4と5の基本行列を求めてそれを回転行列と並進ベクトル

へ分解するプロセスです。

サンプルコードで言うとほんの一部。116~119行目の辺りですね↓

//recovering the pose and the essential matrix Mat E, R, t, mask; E = findEssentialMat(points2, points1, focal, pp, RANSAC, 0.999, 1.0, mask); recoverPose(E, points2, points1, R, t, focal, pp, mask);

findEssentialMatで求めた基本行列を回転行列と並進ベクトルへ分解する関数は上記のrecoverPoseだけじゃなく、decomposeEssentialMatというのも用意されてるんだが、decomposeEssentialMatでは特異値分解で2種類のと1つの

(

組み合わせで4つの解)が算出される。

唯一の解を求めたい場合はrecoverPoseに対応点の情報を渡して使う。

ちなみに、findEssentialMat関数の中身のコードはこちら→modules/calib3d/src/five-point.cpp

five-point(5点アルゴリズム)ってファイル名なのね。

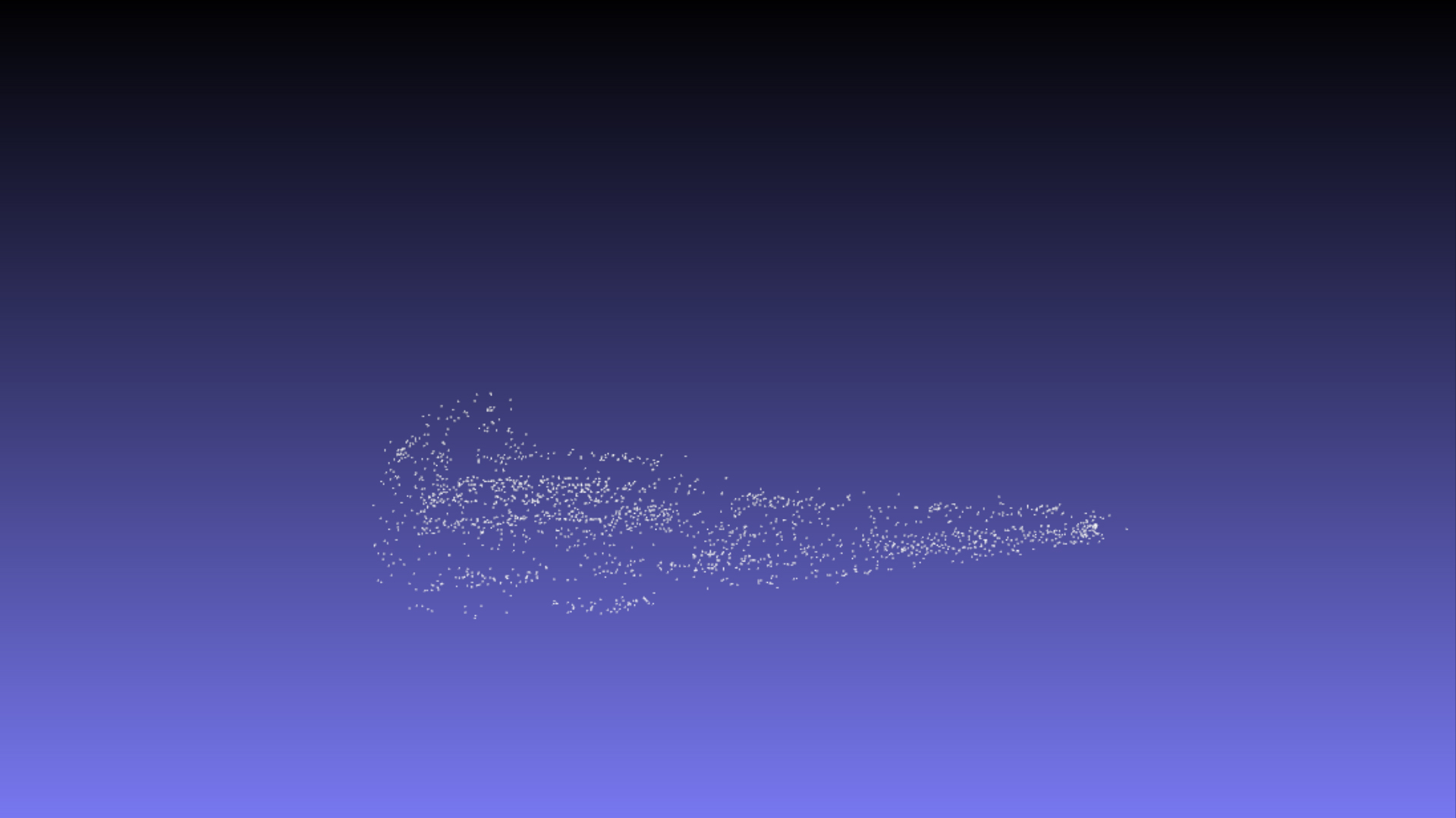

さて、オイラが何でこんなにしつこく勉強しているかというと、画像認識技術を測量ツールとして使いたかったりするのです。

http://pukulab.blog.fc2.com/blog-entry-42.html

http://pukulab.blog.fc2.com/blog-entry-44.html

5点アルゴリズムで推奨されるのは、5点の内の3点が同一平面状にあり、残り2点が任意の位置にあるような条件らしい。

追記:その後、OpenCVの三角測量関数 cv::triangulatepointsもいじってみた↓

関連記事

SDカードサイズのコンピューター『Intel Edison』

WordPressのサーバ引っ越し方法を考える

Google Chromecast

PSPNet (Pyramid Scene Parsing ...

第1回 3D勉強会@関東『SLAMチュートリアル大会』

ROSの薄い本

MeshLab:3Dオブジェクトの確認・変換に便利なフリーウ...

Mechanizeで要認証Webサイトをスクレイピング

このブログのデザインに飽きてきた

なんかすごいサイト

OpenMayaのPhongShaderクラス

機械学習手法『Random Forest』

書籍『仕事ではじめる機械学習』を読みました

OpenCVの三角測量関数『cv::triangulatep...

Point Cloud Consortiumのセミナー「3D...

DUSt3R:3Dコンピュータービジョンの基盤モデル

Quartus II

ManimML:機械学習の概念を視覚的に説明するためのライブ...

Raspberry Pi 2のGPIOピン配置

CGAN (Conditional GAN):条件付き敵対的...

チャットツール用bot開発フレームワーク『Hubot』

Composition Rendering:Blenderに...

Accord.NET Framework:C#で使える機械学...

ArUco:OpenCVベースのコンパクトなARライブラリ

3分の動画でプログラミングを学習できるサイト『ドットインスト...

iPhoneで3D写真が撮れるアプリ『seene』

Raspberry Pi

AR (Augmented Reality)とDR (Dim...

フォトンの放射から格納までを可視化した動画

自前Shaderの件 解決しました

viser:Pythonで使える3D可視化ライブラリ

Human Generator:Blenderの人体生成アド...

1枚の画像からマテリアルを作成できる無料ツール『Materi...

adskShaderSDK

Active Appearance Models(AAM)

Unityの薄い本

UnrealCV:コンピュータビジョン研究のためのUnrea...

ブログが1日ダウンしてました

NumSharp:C#で使えるNumPyライクな数値計算ライ...

続・ディープラーニングの資料

Unityで強化学習できる『Unity ML-Agents』

Unity Scriptコーディング→Unreal Engi...

コメント