カーネギーメロン大学が公開している2D画像からの人体骨格推定ライブラリOpenPoseの元の研究である”Realtime Multi-Person 2D Pose Estimation using Part Affinity Fields“が発表されて以降、2D画像・動画からの骨格推定の研究とソースコードの公開が活発な印象。

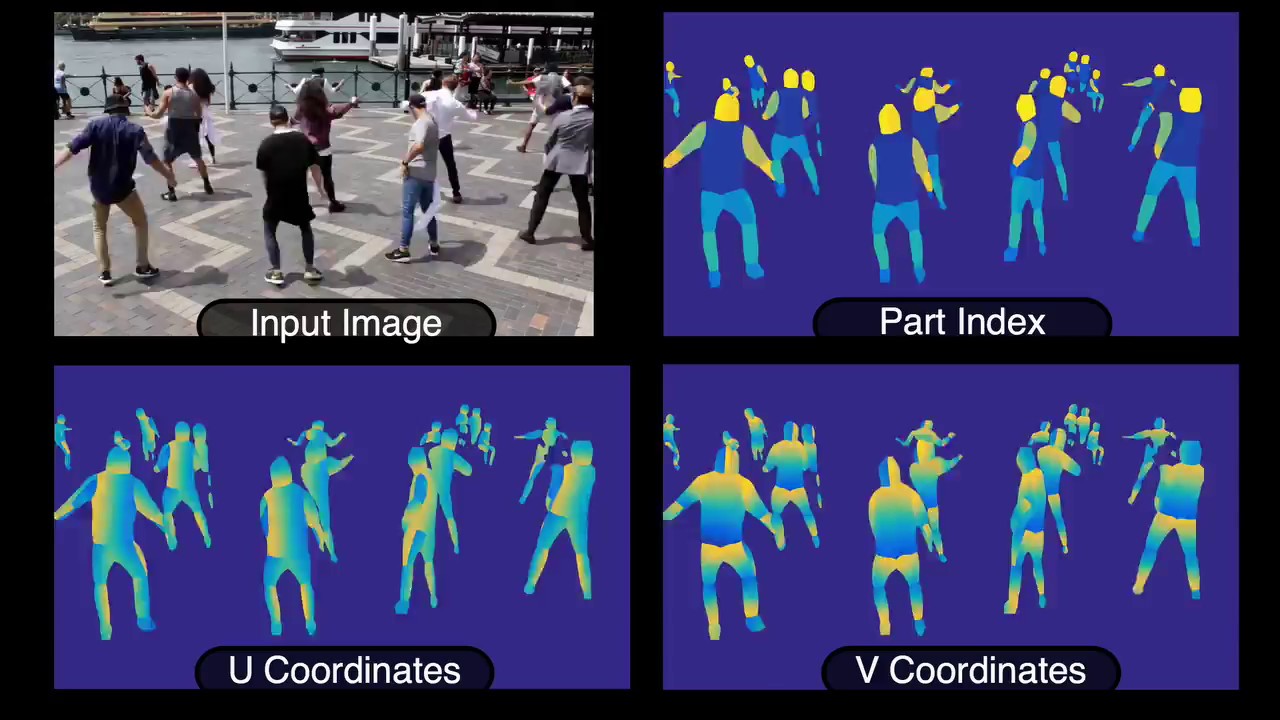

DensePoseは、骨格ではなく、動画中の人物領域の3DサーフェスのUV座標を推定するという、とても具体的なタスクの研究。面白そうなので論文がarXivに公開されてからすぐに読んだのでした。

ただ、CGに詳しくない人には課題設定がピンと来ないんじゃないかな。

DensePose: Dense Human Pose Estimation In The Wild

Dense human pose estimation(密な人体姿勢推定)は、画像中の人物のRGB画素全てを3Dの人体サーフェスへマッピングすることを目的としています。

DensePose-COCOデータセットも公開予定だそうです。

https://github.com/arXivTimes/arXivTimes/issues/638

ソースコードがGitHubで公開されましたね↓

https://github.com/facebookresearch/DensePose

Dockerfileもあるので試すのは楽か?

2018年12月 追記:試した方がいます↓

http://whoopsidaisies.hatenablog.com/entry/2018/12/03/193759

これって、顔画像で言うところのFace Alignmentに近い役割ができて、Body Alignmentって言っても良さそう。

画像中から人物表面のUV座標が推定できれば、身体の模様(つまり服装)を比べたり、入れ替えたり、描き替えたりできるんですよね。

著者にFacebook AI Researchの人が2人入ってるけど、やっぱり目指すのは画像からの個人識別なんですかね。

https://research.fb.com/facebook-open-sources-densepose/

https://shiropen.com/seamless/facebook-ai-densepose

論文では、データセットを作るためのアノテーションツールを設計と、アノテーションの質の評価についても載っている。

ちゃんと解きたいタスクに適したデータセットを用意して、タスクに適したネットワークを設計する、ってのが機械学習の良いアプローチなのだろうか。

機械学習でOverfitting(過学習)と呼ばれる現象は、データセットとタスクのギャップと言えるのかもしれない。

2019年追記:最近はRunway MLというツールで手軽にDensePoseを試すことができるぞ↓

コメント