最近、iOSデバイスと連携して動作するガジェットの開発方法について調べてたんだけど、iOSデバイスと通信する方法もいくつかあるようだ。沢山あって結構ややこしかったので、一覧にしてみる。

まず接続方法には、大きく分けて有線接続、無線接続の2通りがある。

有線接続

Lightningケーブル接続

直接接続

サードパーティ製のMIDIアダプタ経由の接続

サードパーティ製のシリアル通信対応ケーブル経由の接続

イヤフォンジャック接続

無線接続

Wi-Fi接続

Bluetooth (SPP: Serial Port Profile)接続

Bluetooth 4.0 +LE (BLE: Bluetooth Low Energy)接続

そして、開発の難易度はAppleのライセンスポリシーが大きく影響してくる。何で有線接続方法がやたらと回りくどく細分化しているのかと言うと、Lightningケーブルで直接接続して通信するデバイスを開発するには、普通のiOS Developer Program契約だけでなく、別途Appleとのライセンス契約が必要となるからなのだ。

Lightningケーブル接続でiOSデバイスと直接接続して通信可能なガジェットを開発するにはMFi Programというライセンス契約を結ばないと、ドキュメントやSDKなどの開発リソースを入手することができない。Bluetooth (SPP: Serial Port Profile)による通信を行うデバイス開発も同様に、MFi Programの契約が必要となる。ちなみにMFiってのは「Made For iPhone」の略らしい。

ここ最近、Bluetooth 4.0 +LE (BLE: Bluetooth Low Energy)で連携するガジェットがやたらと流行りだした理由の1つは、MFi Programの契約無しで開発可能な点も大きいようだ。

有線接続での通信方法としては、イヤフォンジャックで音声信号をやり取りする方法もある。この方法はMFi Program不要なので、着手の敷居がかなり低く、有線接続の方法としては最も手軽みたい。手軽に開発できるマイコンとしてお馴染みのArduinoではイヤフォンジャック経由で通信するためのSoftModemというライブラリもすでにある。SoftModemはその名のとおりソフトウェア・モデムのことで、デジタル信号と音声信号を相互に変換できるらしい。

MFi Program契約無しで有線接続するもう一つの方法として、サードパーティ製のMFiライセンス取得済みデバイスを経由する方法がある。注意点は、この方法で開発したアプリは個人使用限定のものとなり、AppStoreで配布することができないという点。

現時点でオイラが知っているのは、MIDIインターフェイスを経由する方法と、Lightningケーブルをシリアル通信へ変換するアダプタ・SDKを使う方法。

iOS対応のMIDIインターフェイスはたくさん出ている。中でも割とメジャーなのはIK Multimedia社のiRig MIDI 2。IK Multimedia社は以前、エレキギターとiPhoneを接続した時にもお世話になったメーカーですね。

そしてLightningケーブルをシリアル通信へ変換するアダプタ・SDKについては、Redpark社がLightning端子からシリアル通信へ変換するケーブルとSDKを配布している。

オイラが作るとしたら間違いなく個人利用になるんだけど、どうせ作るんだったらMFi Programで契約して直接接続したいなぁ。そっちの方がスマートだし。MFi Programって個人で契約できないのかな。

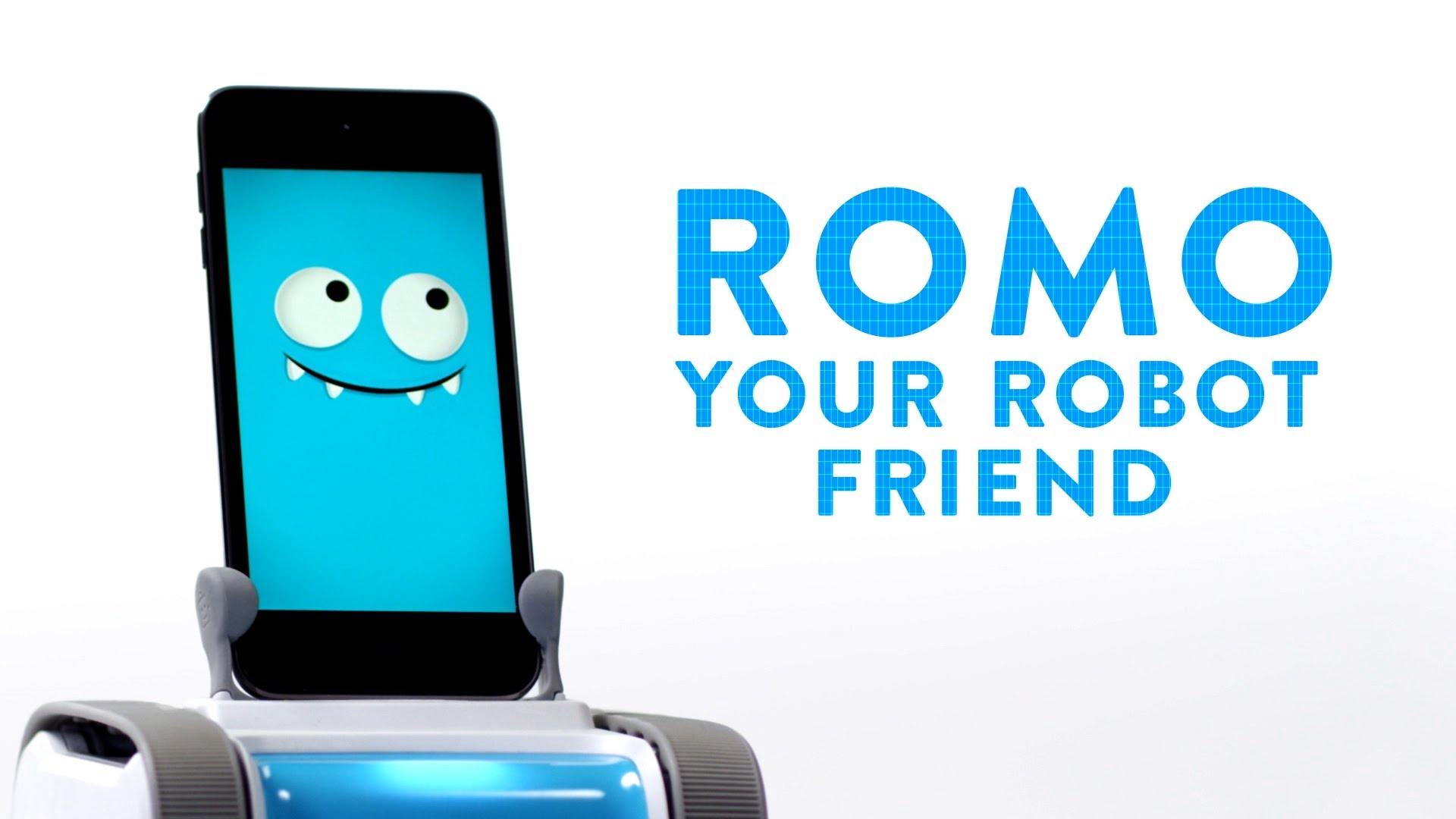

Romoみたいなガジェットを開発するのって結構ハードル高いのね。

関連記事

Kornia:微分可能なコンピュータービジョンライブラリ

PyDataTokyo主催のDeep Learning勉強会

UnityのAR FoundationでARKit 3

UnityのGameObjectの向きをScriptで制御す...

Verilog HDL

機械学習に役立つPythonライブラリ一覧

UnityのTransformクラスについて調べてみた

Unityで学ぶC#

WinSCP

SVM (Support Vector Machine)

CGレンダラ研究開発のためのフレームワーク『Lightmet...

COLMAP:オープンソースのSfM・MVSツール

AnacondaとTensorFlowをインストールしてVi...

Super Resolution:OpenCVの超解像処理モ...

ManimML:機械学習の概念を視覚的に説明するためのライブ...

書籍『ゼロから作るDeep Learning』で自分なりに学...

ZBrushで作った3Dモデルを立体視で確認できるVRアプリ...

PythonのHTML・XMLパーサー『BeautifulS...

Unityからkonashiをコントロールする

Webサイトのワイヤーフレームが作成できるオンラインツール

C++始めようと思うんだ

BlenderProc:Blenderで機械学習用の画像デー...

TeleSculptor:空撮動画からPhotogramme...

まだ続くブログの不調

Manim:Pythonで使える数学アニメーションライブラリ

OpenCVのバージョン3が正式リリースされたぞ

adskShaderSDK

手を動かしながら学ぶデータマイニング

OpenCV

CGALDotNet:計算幾何学ライブラリ CGALのC#ラ...

PyMC:Pythonのベイズ統計ライブラリ

Cartographer:オープンソースのSLAMライブラリ

bpy-renderer:レンダリング用Pythonパッケー...

動的なメモリの扱い

Pythonのソースコードに特化した検索エンジン『Nulle...

UnityのMonoBehaviourクラスをシングルトン化...

Alice Vision:オープンソースのPhotogram...

OpenCVで動画の手ぶれ補正

TensorSpace.js:ニューラルネットワークの構造を...

SDカードサイズのコンピューター『Intel Edison』

RSSフィードを読込んで表示するWordpressプラグイン...

iPhoneをSSHクライアントとして使う

コメント