オープンソースのクリエイター向けGUIモデリングツールのMakeHumanがついにAPIの準備を始めたぞ。現状でも、中身のPythonコードを読もうと思えば読めなくもないんだけど、まあ、しんどかったね。オープンソースだったのに今まで開発者用のAPIが無かったってのも不思議だけど、クリエイター向けだったからかな。これは期待したい。

公式ブログのアナウンス記事をヘッポコ翻訳してみた。↓

The MakeHuman API Project (MHAPI)

新参の開発者にとって、MakeHumanの内部構造を把握するのはかなり難しいことだと私達は経験的に知っています。

また、MakeHumanのソースコードに多数の修正を加えていくと、必然的にその複雑度は増していきます。

私達は新参開発者のために、そしてMakeHumanより簡単にを拡張できるようにするために、MakeHuman API Project (MHAPI)を始めます。

モチベーション

通常、ソースコードというものは技術指向なものです。

あなたが何かプログラムを作る時、そのプログラムが動くことを第一に考えるはずです。 大抵の場合、あなたは技術的な実装を中心に構造を作り、呼び出し処理や、技術的な実装に対応したサブルーチンを追記していくことでしょう。

このやり方の利点は、コア機能がむき出しの状態なので、あなたは直にそれにアクセス出来るという点だ。つまり、あなたは何の制約もなく自由にできるということだ。

このやり方の欠点は、どのように変更・改良を実装するかを考える前に、まずこの技術はどのような構造で、どのように実装されているのかを詳細に把握しなければならない点だ。

この欠点は、技術指向のAPIでも同様である。機能の呼び出し方が分からない時は、まず実装技術の詳細を理解する必要があり、利用可能かどうかはその後に知ることとなる。言うまでもなく、その技術がどのような構造で実装されているのか理解していなければ、正しく使う呼び出し方を見つけるのは非常に難しいだろう。別のAPIの構成方法として、技術的な実装ではなく、タスク指向で、概念を中心に捉える方法があります。この方法では、まず最初に、あなたが何をしたいのかを知り、それができる呼び出しを探す。ここでの呼び出しは、実装の詳細ではなく、コンセプトに沿って構成される。これには利点がいくつかあり、新参の開発者でもスムーズに開発に着手でき、APIに対して書かれたコードの意図が明確になり、バックグラウンドの実装が変化してもAPIを安定した状態に保つことができる。

この構成の欠点は、コードの記述方法と実際の動作方法が乖離してしまうという点と、APIを最新の実装技術に保つためのメンテナンスコストがかかる点である。ビジョン

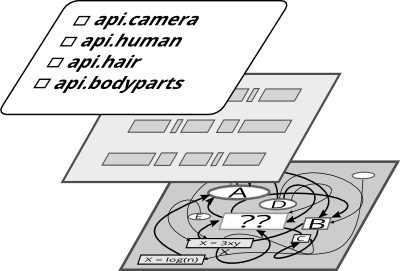

MHAPIプロジェクトの目標は、DSL(ドメイン固有言語)に近づけること、すなわち、意図で呼び出せて、とても使いやすいPythonベースのスクリプト言語にすることだ。APIは、まずはプラグイン経由で拡張機能を記述するものとして開発するが、長期的に考えれば、必ずしもこのような新しいコードを制限する造りである必要はない。我々のビジョンは、基本的なプログラミングスキルを持った人が、APIの解説にざっと目を通した数分以内にMakeHumanのプラグインのコピーを作成するなど、コード開発を始められるようにすることだ。構造

先に述べたとおり、呼び出しはタスク指向とコンセプトラインに沿ってソートされる。APIのサブセットは以下のようになる(まだ構想段階のため、検討中のレイアウト)api camera zoom() move() rotate() ... human applyTarget() setAge() ... clothes equipClothing() setClothingColor() ... interface addButton() addTab() ... messages showMessageBox() writeMessageToLog() ...この種のAPIで、人間に帽子をかぶせるには、例えばapi.clothes.equipClothing(“fedora”)といった1つの簡潔な呼び出し方法が必要だろう。ボタンや機能を持ったタブの追加も、同様に簡単にすることを目指している。

上記はすべて一例にすぎないということに注意してほしい。APIの設計が完了したわけではない。

訳が「ですます」調から途中で「である」調に変わっちゃったけど気にしない。

関連記事

ZBrushで仮面ライダーBLACK SUNを作る 頭部~バ...

WordPress on Google App Engine...

UnityでShaderの入力パラメータとして行列を渡す

TensorFlowでCGを微分できる『TensorFlow...

Google App EngineでWordPress

物理ベースレンダリングのためのマテリアル設定チートシート

Raspberry Pi 2を買いました

UnityのMonoBehaviourクラスをシングルトン化...

白組による『シン・ゴジラ』CGメイキング映像が公開された!

HD画質の無駄遣い その2

Photo Bash:複数の写真を組み合わせて1枚のイラスト...

Pythonのソースコードに特化した検索エンジン『Nulle...

ZBrushのTranspose Masterでポーズを付け...

OpenCVの三角測量関数『cv::triangulatep...

映画『ジュラシック・ワールド』のVFXメイキング

ZBrushでゴジラ2001を作ってみる 姿勢の変更

書籍『開田裕治 怪獣イラストテクニック』

Mean Stack開発の最初の一歩

ZBrushのUV MasterでUV展開

Python.NET:Pythonと.NETを連携させるパッ...

ZBrushでアヴァン・ガメラを作ってみる おでこ(?)のバ...

CycleGAN:ドメイン関係を学習した画像変換

ブログをGoogle App EngineからAmazon ...

C#で使える遺伝的アルゴリズムライブラリ『GeneticSh...

Google App Engine上のWordPressでA...

レンダラ制作はOpenGL とか DirectX を使わなく...

Unityの薄い本

CGWORLD CHANNEL 第21回ニコ生配信は『シン・...

OANDAのfxTrade API

ブログの復旧が難航してた話

ラクガキの立体化

PythonのHTML・XMLパーサー『BeautifulS...

フォトンの放射から格納までを可視化した動画

ZBrushで基本となるブラシ

2012のメイキングまとめ(途中)

geometry3Sharp:Unity C#で使えるポリゴ...

trimesh:PythonでポリゴンMeshを扱うライブラ...

Houdiniのライセンスの種類

Cartographer:オープンソースのSLAMライブラリ

FreeMoCap Project:オープンソースのマーカー...

色んな三面図があるサイト

BlenderのPython環境にPyTorchをインストー...

コメント