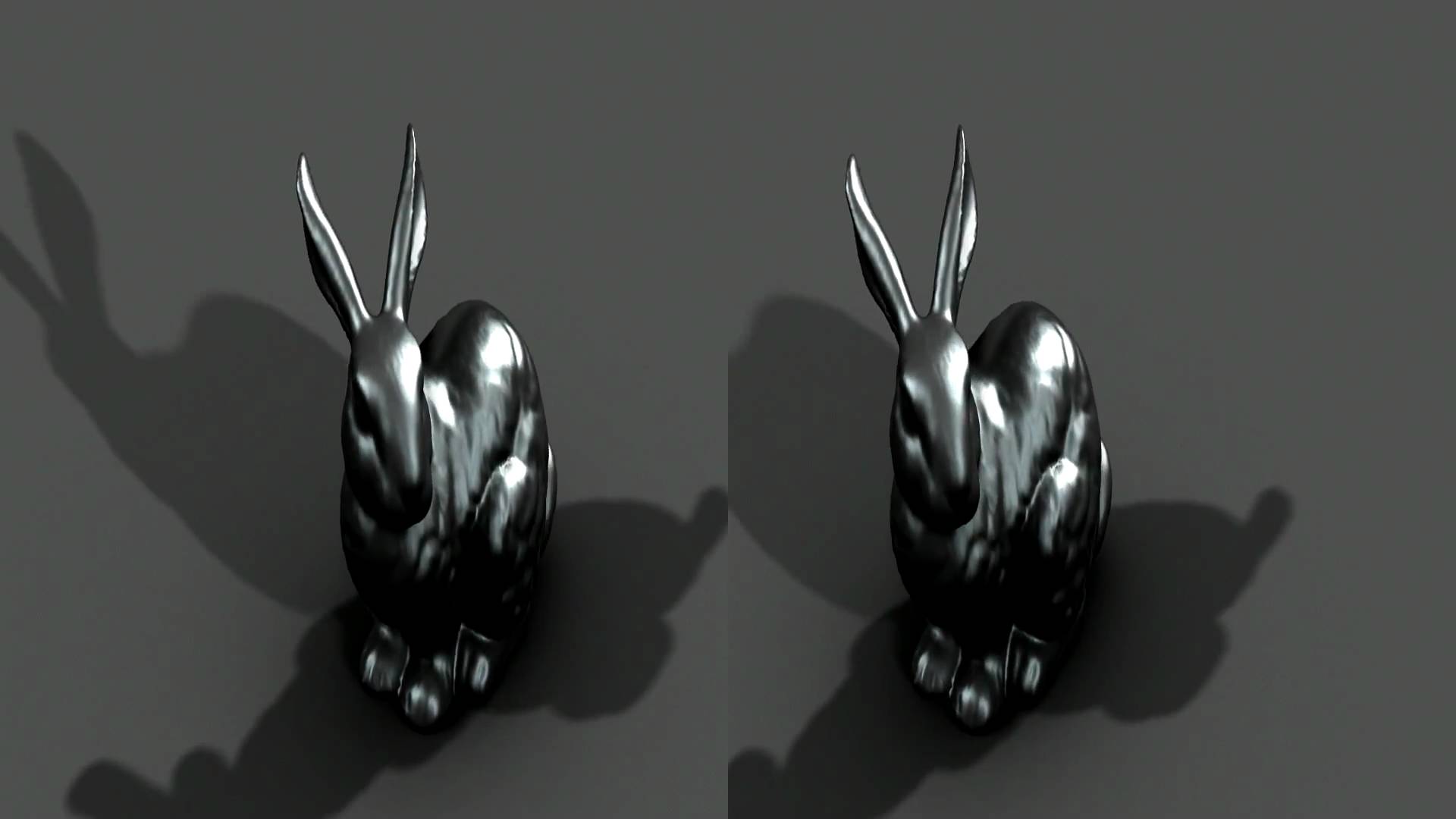

最近、立体視用のモニタ(偏光メガネで見るやつ)を1つ後輩から強奪した譲り受けたんで、適当に視差を作って色々試してみた。(youtubeは立体視にも対応してるんですね)

ちょっとやってみた感想としては、どうやら視差があり過ぎると人間の眼の認識が追いついて来ない感じ。(ちなみに、人間の平均的な両眼距離は6.5cmだそうです)

被写体とカメラの距離、画角、二つのカメラの注視点もちゃんと考えないといけない模様。(まあ、当然か)

眼はモニタ画面を注視するわけだけど、視差が大きくて像がかなり手前に飛び出す場合、手前を注視する感覚へ反射的に頭を切り替えるのがなかなか難しい。(自分だけかもしれないけど)

ただ、人間が認識しやすいように視差を減らすと、じゃあ立体視の意味があるのかという話でもある。

それから、これは偏光方式の質の問題もあると思うけど、像を立体として認識するには、色も重要な要素なんじゃないかと。オイラの作った視差動画は色味がほとんど無いんで、眼が認識しづらかったんじゃないだろうか。偏光メガネでも反対の眼用成分を完全に遮断できないようで、色味が無いと薄っすら見える反対成分と混同して認識してしまう。ということで予想としては、モノクロで視差を作っても効果が薄いんじゃないだろうか。(閲覧環境の質に依存する要素だけど)

ところで、以前もMayaのバージョンを上げた時にちょっと問題が発生した自前Shaderなんだけど、今回バッチ処理でさらに問題発覚。カレントフレームではレンダリングできるのに、バッチに投げると全く描画されなくなる。てっきりレンダーレイヤーの設定を間違えたのかと思ってたんだけど、そういうわけじゃないらしい。バッチに投げると、Shaderを割り当てられてたオブジェクトがまるで透明になったかのように影も形も出ない状態に。バージョンのせい?64bitにしたせい?わからん。

追記:バッチに投げるとShaderが動かない原因はどうやらMTypeIDのせいらしい。環境が変わったことでIDが他のノードとかぶったりしてるのかも。オイラがいいかげんにIDつけてたのがいけなかった。こういうところはスクリプトに劣る部分だな。

関連記事

BSDF: (Bidirectional scatterin...

ZBrush4新機能ハイライト 3DCG CAMP 2010

オープンソースのネットワーク可視化ソフトウェアプラットフォー...

C++ 標準テンプレートライブラリ (STL)

OpenCVの三角測量関数『cv::triangulatep...

ラクガキの立体化

UnrealCV:コンピュータビジョン研究のためのUnrea...

OpenCV 3.1のsfmモジュールのビルド再び

TensorFlowでCGを微分できる『TensorFlow...

NeRF (Neural Radiance Fields):...

ArUco:OpenCVベースのコンパクトなARライブラリ

「ベンジャミン·バトン数奇な人生」でどうやってCGの顔を作っ...

海外ドラマのChromaKey

ZBrushと液晶ペンタブレットでドラゴンをモデリングするチ...

Windows Server 2008にAutodesk M...

R-CNN (Regions with CNN featur...

Raytracing Wiki

ZBrushでゴジラ2001を作ってみる 目元だけ作り込んで...

Digital Emily Project:人間の顔をそっく...

Runway ML:クリエイターのための機械学習ツール

UnityのAR FoundationでARKit 3

Polyscope:3Dデータ操作用GUIライブラリ

OpenGVの用語

Composition Rendering:Blenderに...

Mitsuba 3:オープンソースの研究向けレンダラ

映画『ゴジラ-1.0』 メイキング情報まとめ

ZBrushでアヴァン・ガメラを作ってみる

C++始めようと思うんだ

オープンソースの顔認識フレームワーク『OpenBR』

CycleGAN:ドメイン関係を学習した画像変換

機械学習手法『Random Forest』

OpenCVで平均顔を作るチュートリアル

リメイク版ロボコップスーツのメイキング

白組による『シン・ゴジラ』CGメイキング映像が公開された!

ドラマ『ファーストクラス』のモーショングラフィックス

Physics Forests:機械学習で流体シミュレーショ...

『スター・ウォーズ 最後のジェダイ』のVFXブレイクダウン ...

AR (Augmented Reality)とDR (Dim...

fSpy:1枚の写真からカメラパラメーターを割り出すツール

生物の骨格

SIGGRAPH 2020はオンライン開催

ZBrushでアヴァン・ガメラを作ってみる 壊れたデータの救...

コメント