Amazonの新しいスマホに搭載されてちょっと話題になったけど、カメラから画像認識技術を使ってユーザーの視線を計算すれば、2Dの普通のディスプレイでも疑似的に3D映像を表示することができる。Amazonはこの疑似表示方法をDynamic Perspectiveと呼んでいる。

これは、対象ユーザーが1人の場合に可能な方法で、ユーザーの目の移動に合わせてディスプレイに表示する映像を変化させることで、奥行きを感じさせるもの。スマホのように手に持つなど、目とディスプレイの位置関係が手振れなどで常に変動する環境が前提。両者の位置が静止した関係では立体感を表現できない。

個人的にこの考え方は非常に好き。この考え方というのは、表示を3Dにすることでよりリッチにしようって考えのこと。3Dテレビが盛り上がらなかったせいなのか、割と「3Dは無意味」って認識が根強いんだけど、コンテンツを作りづらいのが普及の一番の足かせだったと思う。日常生活で空間認識している状態に近い情報提示手段の方が、より直観的なUIだとオイラは考えている。

もちろん2Dの方が相応しい場合もあるとは思うけど、3Dだから可能になることもたくさんあるんじゃないだろうか。文書みたいなデスクトップのパラダイムで生まれた情報は確かに2Dの方が良いんだけどさ。

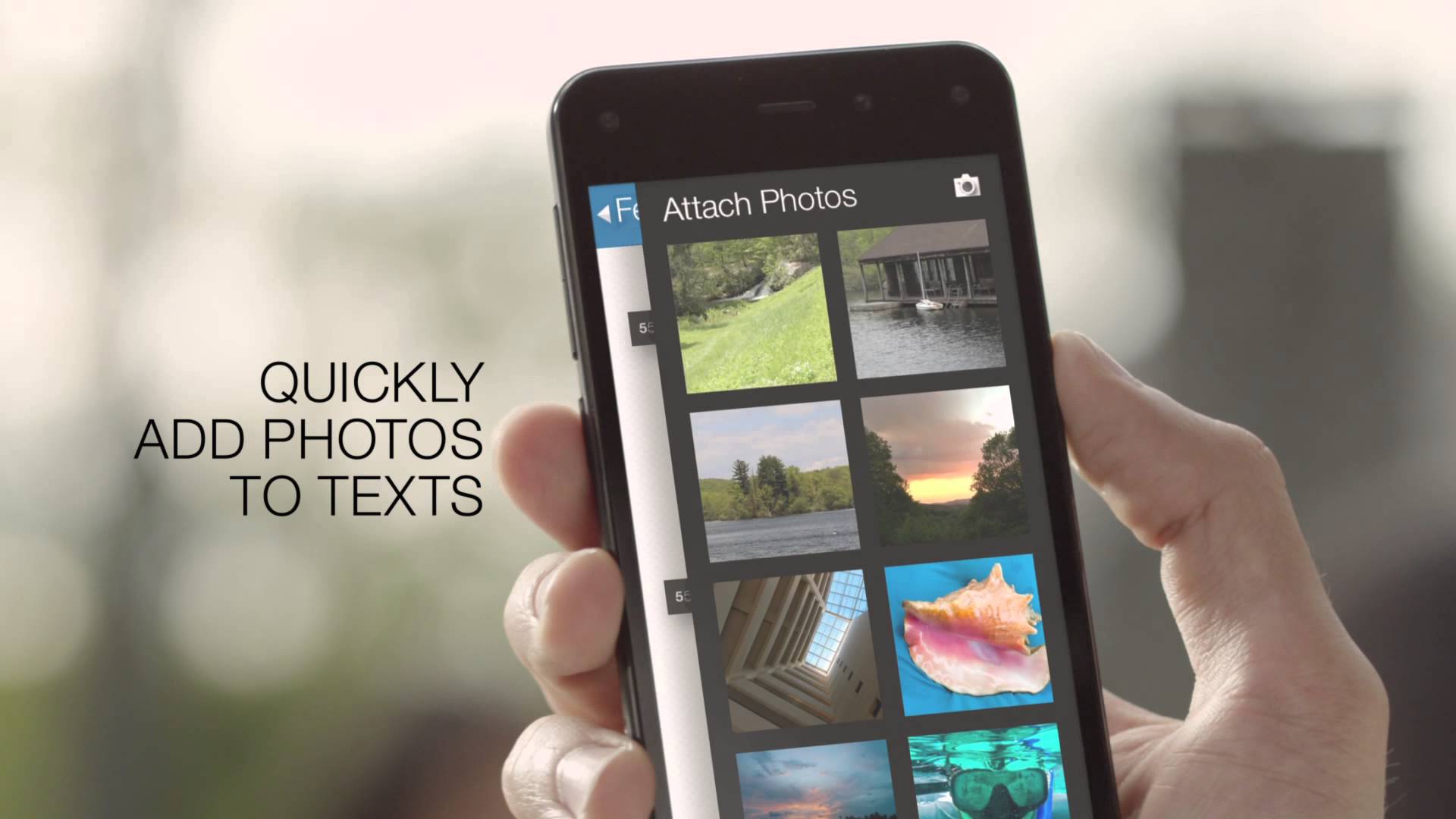

アマゾン初のスマートフォン「Fire Phone」レビュー(前編)–3D効果やデザインなど

アマゾン初のスマートフォン「Fire Phone」レビュー(後編)–アプリや機能、性能など

ちなみに、カメラ画像からの顔追跡には日本のオムロン社のエンジンが使われているらしい。同じ原理でiPadでもソフトウェア的に3D表示を実装することができる。

iPadで実装した例↓

顔や視線でコントロール コンピュータビジョンのセカイ – 今そこにあるミライ

関連記事

UnityでTweenアニメーションを実装できる3種類の無料...

BlenderProc:Blenderで機械学習用の画像デー...

ZBrushで仮面ライダー3号を造る 仮面編 PolyGro...

Mayaでリアルな布の質感を作るチュートリアル

シン・ゴジラのファンアート

SSD (Single Shot Multibox Dete...

Live CV:インタラクティブにComputer Visi...

Javaで作られたオープンソースの3DCGレンダラ『Sunf...

Leap MotionでMaya上のオブジェクトを操作できる...

OpenCV3.3.0でsfmモジュールのビルドに成功!

ZBrush キャラクター&クリーチャー

ZBrushでアヴァン・ガメラを作ってみる 下半身のバランス...

写真から3Dメッシュの生成・編集ができる無料ツール『Auto...

ZBrushでアヴァン・ガメラを作ってみる 下アゴの付け根を...

フィーリングに基づくタマムシの質感表現

Mitsuba 2:オープンソースの物理ベースレンダラ

書籍『The Art of Mystical Beasts』...

映画から想像するVR・AR時代のGUIデザイン

OpenCV

CEDEC 3日目

ZBrushでアヴァン・ガメラを作ってみる 壊れたデータの救...

ZBrushでゴジラ2001を作ってみる 身体のSubToo...

Siggraph Asia 2009 カンファレンスの詳細

Runway ML:クリエイターのための機械学習ツール

映画『ブレードランナー 2049』のVFX

Subsurface scatteringの動画

ZBrushでメカ物を作るチュートリアル動画

OpenCV 3.1とopencv_contribモジュール...

Oculus Goを購入!

第25回コンピュータビジョン勉強会@関東に行って来た

ZBrushのUndo Historyをカメラ固定で動画化す...

PureRef:リファレンス画像専用ビューア

Alice Vision:オープンソースのPhotogram...

ZBrushと液晶ペンタブレットでドラゴンをモデリングするチ...

自前Shaderの件 解決しました

OpenCVで平均顔を作るチュートリアル

COLMAP:オープンソースのSfM・MVSツール

SDカードサイズのコンピューター『Intel Edison』

顔のモデリング

ZBrushの作業環境を見直す

1枚の画像からマテリアルを作成できる無料ツール『Materi...

Unreal Engine 5の情報が公開された!

コメント